詳解數據服務共享發布與數據處理服務 構建高效數據生態的雙引擎

在數字化轉型浪潮中,數據已成為核心生產要素。如何安全、高效地管理、處理并釋放數據價值,是各類組織面臨的共同課題。數據服務共享發布與數據處理服務,作為現代數據架構中的兩大關鍵組件,共同構成了驅動數據價值流轉與業務創新的雙引擎。本文將深入解析二者的核心內涵、技術實踐及協同關系。

一、 數據處理服務:數據的“煉金術”

數據處理服務專注于對原始數據進行一系列加工、轉換與整合,將其轉化為可供分析或應用的高質量、結構化數據。它是數據價值鏈中的核心生產環節。

- 核心目標:提升數據的可用性、一致性、準確性與時效性,為上層的數據消費(如分析、共享、應用開發)奠定堅實基礎。

- 主要范疇:

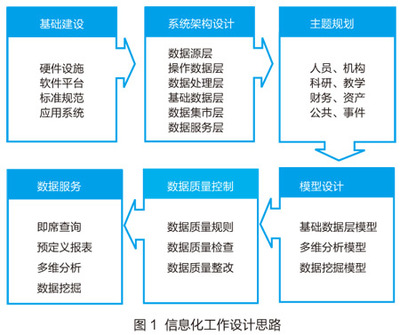

- 數據集成:從異構數據源(數據庫、API、文件等)抽取、清洗、轉換并加載(ETL/ELT)到統一的數據倉庫或數據湖。

- 數據開發與治理:進行數據建模、質量校驗、血緣追蹤、元數據管理等,確保數據處理過程的可控、可信與可審計。

- 實時處理:通過流式計算技術(如Flink, Spark Streaming)對實時數據流進行即時處理與分析,滿足實時監控、預警等場景需求。

- 數據計算與挖掘:執行復雜的批處理計算、機器學習模型訓練與推理,從數據中提煉深層洞察。

- 關鍵特征:強調過程的可靠性、性能與成本控制,通常在企業內部的數據平臺或云端大數據服務中完成。

二、 數據服務共享發布:價值的“傳送門”

數據服務共享發布則聚焦于將處理好的數據,以安全、便捷、標準化的方式“產品化”并交付給內外部用戶或應用系統。它是連接數據生產與消費的橋梁。

- 核心目標:實現數據資產的可發現、可理解、可訪問與可復用,促進數據在組織內乃至生態間的安全流通與價值兌現。

- 主要實現形式:

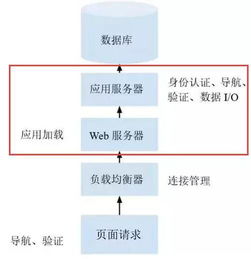

- API服務化:將數據或數據能力封裝成標準的API(如RESTful API),供應用系統按需調用。這是目前最主流的共享發布方式。

- 數據產品目錄/市場:建立統一的數據資產目錄,對數據服務進行編目、描述和分類,使用者可以像在應用商店一樣瀏覽、申請和訂閱所需數據服務。

- 數據文件/數據庫共享:在嚴格權限控制下,通過安全通道提供數據文件下載或數據庫查詢訪問。

- 分析報表共享:將處理后的分析結果以可視化報表、儀表盤等形式發布給業務人員。

- 關鍵特征:強調用戶體驗、訪問控制、計量計費、服務等級協議(SLA)以及合規性(如數據脫敏、隱私保護)。

三、 雙引擎協同:從數據到價值的閉環

數據處理服務與數據服務共享發布并非孤立存在,而是緊密銜接、循環增強的關系,共同構成數據運營的完整閉環。

- 流水線式協作:數據處理服務是“上游工廠”,負責生產高質量的“數據半成品或成品”;數據服務共享發布是“下游渠道與門店”,負責包裝、上架并安全地交付給最終“消費者”。沒有高質量的處理,共享的數據將失去價值基礎;沒有高效的共享,處理的數據將無法發揮價值。

- 需求驅動反饋:數據服務共享平臺收集到的用戶訪問行為、性能反饋、新的數據需求,可以反向驅動數據處理服務的優化與迭代,例如增加新的數據清洗規則、開發新的數據模型或提升處理性能以滿足SLA。

- 平臺化整合趨勢:先進的數據中臺或數據網格(Data Mesh)架構,正致力于將二者無縫整合。在一個統一的平臺上,數據團隊可以完成從數據接入、開發、治理到服務封裝、發布、運維的全鏈路管理,實現“一次開發,多處共享”。

四、 實踐建議與展望

對于希望構建高效數據能力的組織,建議:

- 統一規劃:將數據處理與數據服務共享納入整體數據戰略,明確各自團隊職責與協作流程。

- 標準先行:建立統一的數據模型規范、API設計規范、數據安全與隱私標準。

- 技術選型:選用支持從處理到發布全生命周期的數據平臺或套件,減少集成復雜度。

- 運營思維:將數據服務視為產品進行運營,關注用戶體驗、服務質量與價值度量。

隨著數據要素市場化配置的深入,數據服務共享發布將更加注重跨組織、跨域的安全可信流通(如通過隱私計算技術)。數據處理服務則將更智能化,融合更多AI能力進行自動化的質量提升與價值挖掘。二者深度融合,將持續賦能數字經濟,釋放前所未有的數據潛能。

如若轉載,請注明出處:http://www.fgcktfhm.cn/product/9.html

更新時間:2026-05-06 01:16:50